Какое количество информации содержится в этом сообщении

![]()

Количество информации

Количество информации как мера уменьшения неопределенности знания.

(Содержательный подход к определению количества информации)

Процесс познания окружающего мира приводит к накоплению информации в форме знаний (фактов, научных теорий и т. д.). Получение новой информации приводит к расширению знаний или, как иногда говорят, к уменьшению неопределенности знания. Если некоторое сообщение приводит к уменьшению неопределенности нашего знания, то можно говорить, что такое сообщение содержит информацию.

Например, после сдачи зачета или выполнения контрольной работы вы мучаетесь неопределенностью, вы не знаете, какую оценку получили. Наконец, учитель объявляет результаты, и вы получаете одно из двух информационных сообщений: “зачет” или “незачет”, а после контрольной работы одно из четырех информационных сообщений: “2”, “3”, “4” или “5”.

Информационное сообщение об оценке за зачет приводит к уменьшению неопределенности вашего знания в два раза, так как получено одно из двух возможных информационных сообщений. Информационное сообщение об оценке за контрольную работу приводит к уменьшению неопределенности вашего знания в четыре раза, так как получено одно из четырех возможных информационных сообщений.

Ясно, что чем более неопределенна первоначальная ситуация (чем большее количество информационных сообщений возможно), тем больше мы получим новой информации при получении информационного сообщения (тем в большее количество раз уменьшится неопределенность знания).

Количество информации можно рассматривать как меру уменьшения неопределенности знания при получении информационных сообщений.

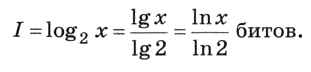

Рассмотренный выше подход к информации как мере уменьшения неопределенности знания позволяет количественно измерять информацию. Существует формула, которая связывает между собой количество возможных информационных сообщений N и количество информации I, которое несет полученное сообщение:

Бит. Для количественного выражения любой величины необходимо сначала определить единицу измерения. Так, для измерения длины в качестве единицы выбран метр, для измерения массы – килограмм и т. д. Аналогично, для определения количества информации необходимо ввести единицу измерения.

За единицу количества информации принимается такое количество информации, которое содержится в информационном сообщении, уменьшающем неопределенность знания в два раза. Такая единица названа битом.

Если вернуться к рассмотренному выше получению информационного сообщения о результатах зачета, то здесь неопределенность как раз уменьшается в два раза и, следовательно, количество информации, которое несет сообщение, равно 1 биту.

Производные единицы измерения количества информации. Минимальной единицей измерения количества информации является бит, а следующей по величине единицей – байт, причем:

1 байт = 8 битов = 23 битов.

В информатике система образования кратных единиц измерения несколько отличается от принятых в большинстве наук. Традиционные метрические системы единиц, например Международная система единиц СИ, в качестве множителей кратных единиц используют коэффициент 10n, где n = 3, 6, 9 и т. д., что соответствует десятичным приставкам “Кило” (103), “Мега” (106), “Гига” (109) и т. д.

В компьютере информация кодируется с помощью двоичной знаковой системы, и поэтому в кратных единицах измерения количества информации используется коэффициент 2n

Так, кратные байту единицы измерения количества информации вводятся следующим образом:

1 килобайт (Кбайт) = 210 байт = 1024 байт;

1 мегабайт (Мбайт) = 210 Кбайт = 1024 Кбайт;

1 гигабайт (Гбайт) = 210 Мбайт = 1024 Мбайт.

Контрольные вопросы

- 1. Приведите примеры информационных сообщений, которые приводят к уменьшению неопределенности знания.

2. Приведите примеры информационных сообщений, которые несут 1 бит информации.

Определение количества информации

Определение количества информационных сообщений.По формуле (1.1) можно легко определить количество возможных информационных сообщений, если известно количество информации. Например, на экзамене вы берете экзаменационный билет, и учитель сообщает, что зрительное информационное сообщение о его номере несет 5 битов информации. Если вы хотите определить количество экзаменационных билетов, то достаточно определить количество возможных информационных сообщений об их номерах по формуле (1.1):

N = 25 = 32.

Таким образом, количество экзаменационных билетов равно 32.

Определение количества информации. Наоборот, если известно возможное количество информационных сообщений N, то для определения количества информации, которое несет сообщение, необходимо решить уравнение относительно I.

Представьте себе, что вы управляете движением робота и можете задавать направление его движения с помощью информационных сообщений: “север”, “северо-восток”, “восток”, “юго-восток”, “юг”, “юго-запад”, “запад” и “северо-запад” (рис. 1.11). Какое количество информации будет получать робот после каждого сообщения?

| Рис. 1.4. Управление роботом с использованием информационных сообщений |

Всего возможных информационных сообщений 8, поэтому формула (1.1) принимает вид уравнения относительно I:

8 = 2I.

Разложим стоящее в левой части уравнения число 8 на сомножители и представим его в степенной форме:

8 = 2 × 2 × 2 = 23.

Наше уравнение:

23 = 2I.

Равенство левой и правой частей уравнения справедливо, если равны показатели степени числа 2. Таким образом, I = 3 бита, т. е. количество информации, которое несет роботу каждое информационное сообщение, равно 3 битам.

Алфавитный подход к определению количества информации

При алфавитном подходе к определению количества информации отвлекаются от содержания информации и рассматривают информационное сообщение как последовательность знаков определенной знаковой системы.

Информационная емкость знака. Представим себе, что необходимо передать информационное сообщение по каналу передачи информации от отправителя к получателю. Пусть сообщение кодируется с помощью знаковой системы, алфавит которой состоит из N знаков {1, …, N}. В простейшем случае, когда длина кода сообщения составляет один знак, отправитель может послать одно из N возможных сообщений “1”, “2”, …, “N”, которое будет нести количество информации I (рис. 1.5).

| Рис. 1.5. Передача информации |

Формула (1.1) связывает между собой количество возможных информационных сообщений N и количество информации I, которое несет полученное сообщение. Тогда в рассматриваемой ситуации N – это количество знаков в алфавите знаковой системы, а I – количество информации, которое несет каждый знак:

N = 2I.

С помощью этой формулы можно, например, определить количество информации, которое несет знак в двоичной знаковой системе:

N = 2 => 2 = 2I => 21 = 2I => I=1 бит.

Таким образом, в двоичной знаковой системе знак несет 1 бит информации. Интересно, что сама единица измерения количества информации “бит” (bit) получила свое название ОТ английского словосочетания “Binary digiT” – “двоичная цифра”.

Информационная емкость знака двоичной знаковой системы составляет 1 бит.

Чем большее количество знаков содержит алфавит знаковой системы, тем большее количество информации несет один знак. В качестве примера определим количество информации, которое несет буква русского алфавита. В русский алфавит входят 33 буквы, однако на практике часто для передачи сообщений используются только 32 буквы (исключается буква “ё”).

С помощью формулы (1.1) определим количество информации, которое несет буква русского алфавита:

N = 32 => 32 = 2I => 25 = 2I => I=5 битов.

Таким образом, буква русского алфавита несет 5 битов информации (при алфавитном подходе к измерению количества информации).

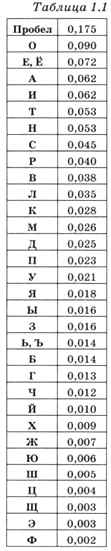

Количество информации, которое несет знак, зависит от вероятности его получения. Если получатель заранее точно знает, какой знак придет, то полученное количество информации будет равно 0. Наоборот, чем менее вероятно получение знака, тем больше его информационная емкость.

В русской письменной речи частота использования букв в тексте различна, так в среднем на 1000 знаков осмысленного текста приходится 200 букв “а” и в сто раз меньшее количество буквы “ф” (всего 2). Таким образом, с точки зрения теории информации, информационная емкость знаков русского алфавита различна (у буквы “а” она наименьшая, а у буквы “ф” – наибольшая).

Количество информации в сообщении. Сообщение состоит из последовательности знаков, каждый из которых несет определенное количество информации.

Если знаки несут одинаковое количество информации, то количество информации Ic в сообщении можно подсчитать, умножив количество информации Iз, которое несет один знак, на длину кода (количество знаков в сообщении) К:

Ic = Iз× K

Так, каждая цифра двоичного компьютерного кода несет информацию в 1 бит. Следовательно, две цифры несут информацию в 2 бита, три цифры – в 3 бита и т. д. Количество информации в битах равно количеству цифр двоичного компьютерного кода (табл. 1.1).

Таблица 1.1. Количество информации, которое несет двоич ный компьютерный код

| Двоичный компьютерный код | 1 | 1 | 1 | ||

| Количество информации | 1 бит | 1 бит | 1 бит | 1 бит | 1 бит |

Источник

Содержание урока

Формула Хартли

Задачи

Информация и вероятность

Вопросы и задания

Задачи

Формула Шеннона

Вопросы и задания

Задачи

Информация и вероятность

Всё, что написано в предыдущем пункте, верно только при одном уточнении: все события (символы алфавита) одинаково ожидаемы, т. е. нельзя заранее сказать, что какой-то символ встречается чаще, а какой-то — реже. В реальности это предположение не всегда верно. Например, в тексте на русском языке некоторые символы встречаются часто, а некоторые — очень редко. Числа во втором столбце табл. 1.1 означают относительную долю символа в больших текстах. Например, доля 0,175 для пробела означает, что примерно 17,5% всех символов в текстах на русском языке — пробелы.

Иногда среди всех возможных событий есть ожидаемые и неожиданные. Например, на вопрос «Идёт ли сейчас снег?» летом мы ожидаем услышать ответ «Нет». При этом ответ «Да» будет очень неожиданным, и после его получения наши дальнейшие планы могут сильно измениться. Это значит, что при таком ответе мы получаем гораздо больше информации. Как её измерить точно?

Сначала нужно разобраться с тем, что значит «менее ожидаемое» событие и «более ожидаемое». Математики в этом случае используют понятие «вероятность»: если событие более ожидаемое, то его вероятность (точнее, вероятность того, что оно произойдёт) больше.

Вероятность — это число в интервале от 0 до 1. В математике вероятность принято обозначать буквой р (от латинского probabi- lis — вероятный, возможный).

Сначала рассмотрим предельные случаи, когда вероятность равна 0 или 1. Пусть, например, х — некоторое неизвестное вещественное число, которое задумал ведущий. Вы знаете, что для любого вещественного х всегда х2 ≥ 0. В этом случае считают, что вероятность события х2 ≥ 0 равна 1 (событие х2 ≥ 0 обязательно произойдёт). Часто вероятность измеряют в процентах от 1, тогда вероятность события х2 ≥ 0 равна 100%. В то же время вероятность события х2 < 0 равна нулю, это значит, что событие х2 < 0 никогда не произойдёт.

Теперь предположим, что мы бросаем монету и смотрим, какой стороной она упала, «орлом» или «решкой». Если повторять этот опыт много раз, мы заметим, что количество «орлов» и «решек» примерно равно (конечно, если монета не имеет дефектов). При этом вероятность каждого из двух событий равна 0,5, или 50%. Скорее всего, вы слышали выражение «50 на 50», которое означает, что ни одному из двух вариантов нельзя отдать предпочтение — их вероятности равны.

Вероятность события можно определить с помощью большого количества испытаний. Если из N испытаний нужное нам событие случилось m раз, то вероятность такого события можно оценить как m/N. Например, классический игральный кубик имеет 6 граней; если кубик качественный, вероятность выпадения каждой грани равна 1/6. Вероятность выпадения чётного числа можно подсчитать так: среди чисел от 1 до 6 всего 3 чётных числа, поэтому при большом числе испытаний в половине случаев (в 3 из 6) будут выпадать чётные числа, т. е. вероятность равна 0,5. А вероятность выпадения числа, меньшего 3, равна 2/6 = = 1/3 ≈ 0,33, потому что только 2 из 6 чисел (1 и 2) удовлетворяют условию.

Теперь можно переходить к главному вопросу: как вычислить количество информации, если в сообщении получен символ, вероятность появления которого равна р. Попробуем сначала определить, какими свойствами должна обладать эта величина, исходя из «здравого смысла».

Во-первых, чем меньше вероятность, тем более неожидан символ и тем больше информации мы получили. Если вероятность события близка к нулю, количество информации должно стремиться к бесконечности (получение такого символа очень неожиданно).

Во-вторых, представим себе, что мы получаем символы только одного вида, например только буквы «А». Тогда вероятность появления символа «А» равна 1 и никакой новой информации в этом символе для нас нет — мы всё заранее знали. Следовательно, при р = 1 информация должна быть равна нулю.

В-третьих, «здравый смысл» подсказывает, что когда мы бросаем игральный кубик два (три, 102, 1002) раза, мы получаем информации в два (три, 102, 1002) раза больше, чем при однократном бросании кубика. Это свойство называют принципом аддитивности (сложения).

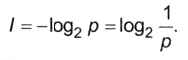

Математики доказали, что этими свойствами обладает только логарифмическая функция вида f(p) = -К • log2 p, где коэффициент К можно выбирать произвольно, как удобно в конкретной задаче. Если взять К = 1, мы получим количество информации в битах.

Если событие имеет вероятность р, то количество информации в битах, полученное в сообщении об этом событии, равно

Поскольку вероятность р не больше 1, количество информации не может быть меньше нуля. Легко проверить, что если вероятность равна 1, то количество полученной информации равно нулю. Если вероятность стремится к 0, величина log2p стремится к -∞, а количество информации — к ∞.

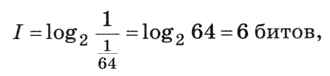

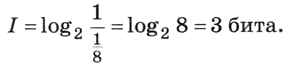

Третье свойство (аддитивность, сложение вероятностей) проверим на примере. Пусть есть два мешка, в каждом из которых лежат 8 шариков разного цвета. Вычислим, какое количество информации мы получили из сообщения «Из первого мешка вытащили (наугад) красный шарик, а из второго — зелёный». Из каждого мешка можно вытащить один из восьми шариков, т. е. вероятность вытащить какой-то определённый шарик равна 1/8. Следовательно, количество информации в сообщении «Из первого мешка вытащили красный шарик» равно

Точно такую же информацию, 3 бита, мы получаем из сообщения «Из второго мешка вытащили зелёный шарик».

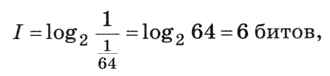

Теперь посмотрим, какое количество информации несёт исходное полное сообщение «Из первого мешка вытащили (наугад) красный шарик, а из второго — зелёный». Какова вероятность именно этого исхода? Есть 8 способов вытащить шарик из каждого мешка, всего получаем 8 • 8 = 64 варианта, поэтому вероятность каждого из них равна 1/64. Тогда количество информации в сообщении равно

т. е. равно сумме количеств информации в двух отдельных сообщениях. Мы показали, что свойство аддитивности выполняется.

Возможно, вы уже заметили, что последний пример фактически свёлся к использованию формулы Хартли. Если все N вариантов имеют равные вероятности, то вероятность каждого варианта равна р = 1/N, следовательно, количество информации о любом из N возможных событий вычисляется как

Этот результат совпадает с формулой Хартли.

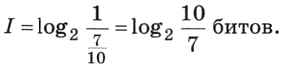

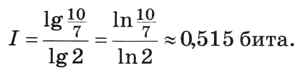

Однако формулу Хартли нельзя использовать, если вероятности событий разные. Пусть, например, детям раздают воздушные шарики разного цвета, причём 7 из каждых 10 шариков — зелёные. Какое количество информации содержится в сообщении «Маша получила зелёный шарик»? Здесь формула Хартли неприменима, однако можно использовать формулу (1). Вероятность того, что Маше достался зелёный шарик, равна 7/10, а количество информации вычисляется как

Величина под знаком двоичного логарифма не является степенью двойки. Как её вычислить? Для этого используется свойство логарифма, позволяющее переходить к другому основанию, например, к десятичным или натуральным логарифмам, которые умеют вычислять калькуляторы:

В данном случае получаем

Следующая страница  Вопросы и задания

Вопросы и задания

Cкачать материалы урока

Источник

Набор символов знаковой системы (алфавит) можно рассматривать как различные возможные состояния (события).

Тогда, если считать, что появление символов в сообщении равновероятно, количество возможных событийN можно вычислить как N=2i

Количество информации в сообщении I можно подсчитать умножив количество символов K на информационный вес одного символа i

Итак, мы имеем формулы, необходимые для определения количества информации в алфавитном подходе:

Если к этим задачам добавить задачи на соотношение величин, записанных в разных единицах измерения, с использованием представления величин в виде степеней двойки мы получим 9 типов задач.

Рассмотрим задачи на все типы. Договоримся, что при переходе от одних единиц измерения информации к другим будем строить цепочку значений. Тогда уменьшается вероятность вычислительной ошибки.

Задача 1. Получено сообщение, информационный объем которого равен 32 битам. чему равен этот объем в байтах?

Решение: В одном байте 8 бит. 32:8=4

Ответ: 4 байта.

Задача 2. Объем информацинного сообщения 12582912 битов выразить в килобайтах и мегабайтах.

Решение: Поскольку 1Кбайт=1024 байт=1024*8 бит, то 12582912:(1024*8)=1536 Кбайт и

поскольку 1Мбайт=1024 Кбайт, то 1536:1024=1,5 Мбайт

Ответ:1536Кбайт и 1,5Мбайт.

Задача 3. Компьютер имеет оперативную память 512 Мб. Количество соответствующих этой величине бит больше:

1) 10 000 000 000бит 2) 8 000 000 000бит 3) 6 000 000 000бит 4) 4 000 000 000бит Решение: 512*1024*1024*8 бит=4294967296 бит.

Ответ: 4.

Задача 4. Определить количество битов в двух мегабайтах, используя для чисел только степени 2.

Решение: Поскольку 1байт=8битам=23битам, а 1Мбайт=210Кбайт=220байт=223бит. Отсюда, 2Мбайт=224бит.

Ответ: 224бит.

Задача 5. Сколько мегабайт информации содержит сообщение объемом 223бит?

Решение: Поскольку 1байт=8битам=23битам, то

223бит=223*223*23бит=210210байт=210Кбайт=1Мбайт.

Ответ: 1Мбайт

Задача 6. Один символ алфавита “весит” 4 бита. Сколько символов в этом алфавите?

Решение:

Дано:

| i=4 | По формуле N=2i находим N=24, N=16 |

| Найти: N – ? |

Ответ: 16

Задача 7. Каждый символ алфавита записан с помощью 8 цифр двоичного кода. Сколько символов в этом алфавите?

Решение:

Дано:

| i=8 | По формуле N=2i находим N=28, N=256 |

| Найти:N – ? |

Ответ: 256

Задача 8. Алфавит русского языка иногда оценивают в 32 буквы. Каков информационный вес одной буквы такого сокращенного русского алфавита?

Решение:

Дано:

| N=32 | По формуле N=2i находим 32=2i, 25=2i,i=5 |

| Найти: i– ? |

Ответ: 5

Задача 9. Алфавит состоит из 100 символов. Какое количество информации несет один символ этого алфавита?

Решение:

Дано:

| N=100 | По формуле N=2i находим 32=2i, 25=2i,i=5 |

| Найти: i– ? |

Ответ: 5

Задача 10. У племени “чичевоков” в алфавите 24 буквы и 8 цифр. Знаков препинания и арифметических знаков нет. Какое минимальное количество двоичных разрядов им необходимо для кодирования всех символов? Учтите, что слова надо отделять друг от друга!

Решение:

Дано:

| N=24+8=32 | По формуле N=2i находим 32=2i, 25=2i,i=5 |

| Найти: i– ? |

Ответ: 5

Задача 11. Книга, набранная с помощью компьютера, содержит 150 страниц. На каждой странице — 40 строк, в каждой строке — 60 символов. Каков объем информации в книге? Ответ дайте в килобайтах и мегабайтах

Решение:

Дано:

| K=360000 | Определим количество символов в книге 150*40*60=360000. Один символ занимает один байт. По формуле I=K*iнаходим I=360000байт 360000:1024=351Кбайт=0,4Мбайт |

| Найти: I– ? |

Ответ: 351Кбайт или 0,4Мбайт

Задача 12. Информационный объем текста книги, набранной на компьютере с использованием кодировки Unicode, — 128 килобайт. Определить количество символов в тексте книги.

Решение:

Дано:

| I=128Кбайт,i=2байт | В кодировке Unicode один символ занимает 2 байта. Из формулыI=K*i выразимK=I/i,K=128*1024:2=65536 |

| Найти: K– ? |

Ответ: 65536

Задача 13.Информационное сообщение объемом 1,5 Кб содержит 3072 символа. Определить информационный вес одного символа использованного алфавита

Решение:

Дано:

| I=1,5Кбайт,K=3072 | Из формулы I=K*i выразимi=I/K,i=1,5*1024*8:3072=4 |

| Найти: i– ? |

Ответ: 4

Задача 14.Сообщение, записанное буквами из 64-символьного алфавита, содержит 20 символов. Какой объем информации оно несет?

Решение:

Дано:

| N=64, K=20 | По формуле N=2i находим 64=2i, 26=2i,i=6. По формуле I=K*i I=20*6=120 |

| Найти: I– ? |

Ответ: 120бит

Задача 15. Сколько символов содержит сообщение, записанное с помощью 16-символьного алфавита, если его объем составил 1/16 часть мегабайта?

Решение:

Дано:

| N=16, I=1/16 Мбайт | По формуле N=2i находим 16=2i, 24=2i,i=4. Из формулы I=K*i выразим K=I/i, K=(1/16)*1024*1024*8/4=131072 |

| Найти: K– ? |

Ответ: 131072

Задача 16. Объем сообщения, содержащего 2048 символов,составил 1/512 часть мегабайта. Каков размер алфавита, с помощью которого записано сообщение?

Решение:

Дано:

| K=2048,I=1/512 Мбайт | Из формулы I=K*i выразим i=I/K, i=(1/512)*1024*1024*8/2048=8. По формулеN=2iнаходим N=28=256 |

| Найти: N– ? |

Ответ: 256

Задачи для самостоятельного решения:

- Каждый символ алфавита записывается с помощью 4 цифр двоичного кода. Сколько символов в этом алфавите?

- Алфавит для записи сообщений состоит из 32 символов, каков информационный вес одного символа? Не забудьте указать единицу измерения.

- Информационный объем текста, набранного на компьюте¬ре с использованием кодировки Unicode (каждый символ кодируется 16 битами), — 4 Кб. Определить количество символов в тексте.

- Объем информационного сообщения составляет 8192 бита. Выразить его в килобайтах.

- Сколько бит информации содержит сообщение объемом 4 Мб? Ответ дать в степенях 2.

- Сообщение, записанное буквами из 256-символьного ал¬фавита, содержит 256 символов. Какой объем информации оно несет в килобайтах?

- Сколько существует различных звуковых сигналов, состоящих из последовательностей коротких и длинных звонков. Длина каждого сигнала — 6 звонков.

- Метеорологическая станция ведет наблюдение за влажностью воздуха. Результатом одного измерения является целое число от 20 до 100%, которое записывается при помощи минимально возможного количества бит. Станция сделала 80 измерений. Определите информационный объем результатом наблюдений.

- Скорость передачи данных через ADSL-соединение равна 512000 бит/с. Через данное соединение передают файл размером 1500 Кб. Определите время передачи файла в секундах.

- Определите скорость работы модема, если за 256 с он может передать растровое изображение размером 640х480 пикселей. На каждый пиксель приходится 3 байта. А если в палитре 16 миллионов цветов?

Тема определения количества информации на основе алфавитного подхода используется в заданиях А1, А2, А3, А13, В5 контрольно-измерительных материалов ЕГЭ.

Источник